Indice

- 1. Addestramento opaco o dati non tracciabili

- 2. Modello che funziona… ma solo sulla demo

- 3. Costi di inferenza incompatibili con il business

- 4. Licenze, componenti open source o dipendenze non documentate

- 5. Nessun audit trail delle decisioni del modello

- 6. Dipendenza da una sola persona (il famoso ML guru)

- 7. Mancanza di governance sulle decisioni tech

- Come evitare tutto questo?

Un conto è avere un modello funzionante. Un altro è superare una due diligence.

Oggi chiunque può costruire un MVP AI che funziona su una demo.

Ma chi vuole raccogliere capitali seri, o essere acquisito, deve superare una prova ben più complessa: una due diligence tecnica condotta da chi sa dove guardare.

E non serve che qualcosa “non funzioni” per far saltare tutto.

Basta uno solo dei seguenti errori per far sollevare dubbi, rallentare l’operazione o – peggio – chiudere la porta.

Ecco 7 errori che vediamo spesso analizzando startup AI in fase di crescita o pre-deal.

1. Addestramento opaco o dati non tracciabili

Se non puoi dimostrare dove hai preso i dati, come li hai trattati e in che condizioni li hai usati… sei a rischio.

Un dataset non documentato, una pipeline “provvisoria”, o l’uso disinvolto di dati sensibili sono bandiere rosse immediate per qualunque VC o buyer.

2. Modello che funziona… ma solo sulla demo

Una demo ben fatta può convincere al primo pitch.

Ma una due diligence guarda sotto il cofano:

- Come si comporta il modello con dati reali?

- Quanto costa servire la predizione?

- Cosa succede sotto stress o in edge case?

- C’è una strategia di retraining o è “one-shot”?

Se il modello non è mantenibile o generalizzabile, non è un asset. È una liability.

3. Costi di inferenza incompatibili con il business

Un modello che costa 0,30 € per ogni chiamata API non è un business scalabile.

Molti founder sottovalutano quanto i costi operativi dell’inferenza possano affossare la marginalità.

E gli investitori lo sanno.

Basta una riga nel modello economico sbagliata per compromettere la trattativa.

4. Licenze, componenti open source o dipendenze non documentate

Se una parte chiave del tuo sistema AI dipende da librerie o modelli esterni, occorre dimostrare che ne hai il diritto d’uso, e che puoi sostituirli se serve.

Inoltre, se la tua intelligenza artificiale è costruita sopra LLM esterni (es. OpenAI, Claude, ecc.), un buon audit verifica quanto sei lockato e quanto controlli davvero.

5. Nessun audit trail delle decisioni del modello

Se l’AI produce una risposta… e nessuno può spiegare come ci è arrivata, hai un problema.

Il problema non è tecnico: è di accountability.

Investitori, buyer e partner vogliono sapere se il tuo sistema può essere auditabile, soprattutto in ambiti regolati (fintech, medtech, assicurativo, HR tech…).

6. Dipendenza da una sola persona (il famoso ML guru)

Molte startup AI funzionano solo perché una persona geniale tiene insieme tutto.

Il bus factor è 1.

La documentazione è nella sua testa.

E il codice è leggibile solo da lei.

Se chi conduce la due diligence se ne accorge – e se ne accorge sempre – la fiducia si azzera.

Il valore percepito crolla.

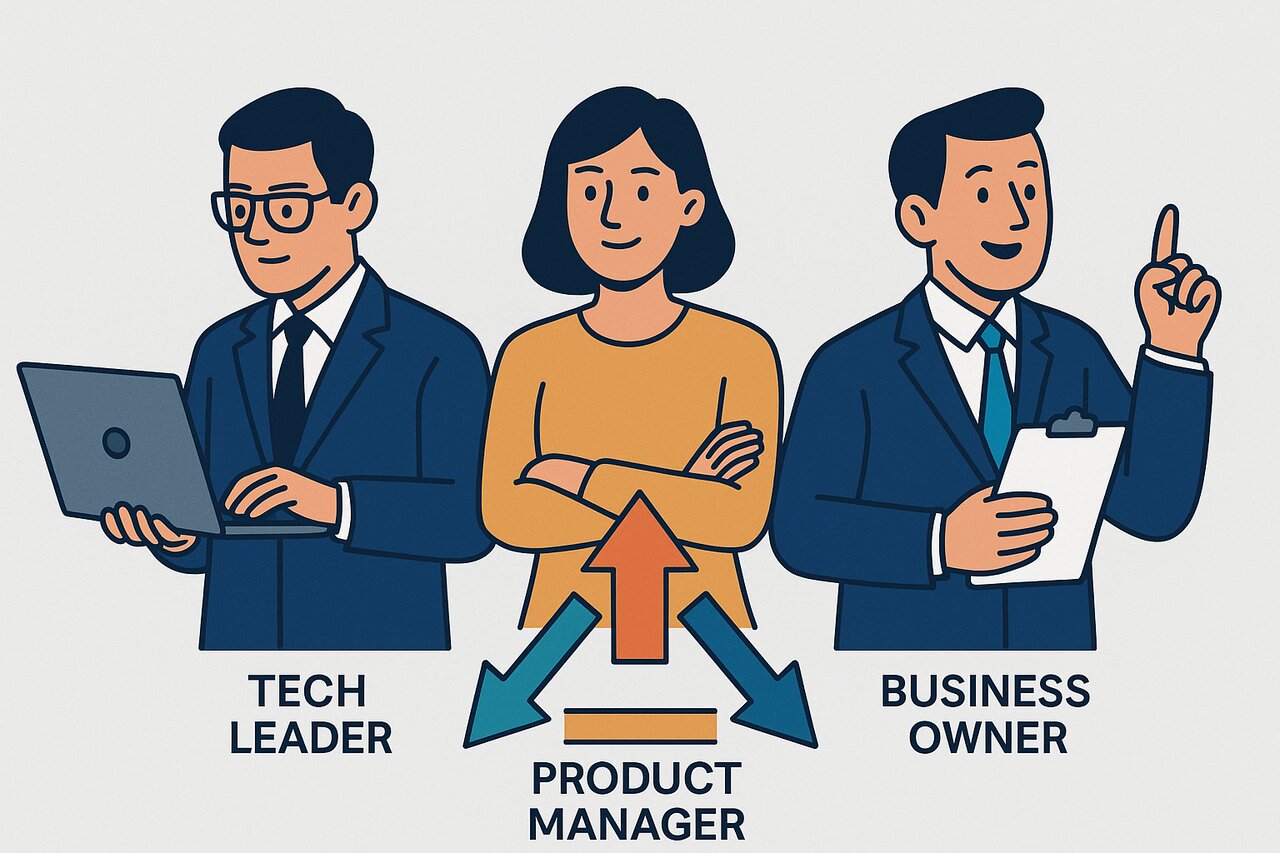

7. Mancanza di governance sulle decisioni tech

Chi decide quando si retraina il modello?

Chi valuta se un’architettura va sostituita?

Chi gestisce il budget sull’AI stack?

Chi può intervenire in caso di drift o bias?

Se non sai rispondere con chiarezza, allora non hai una governance tech, e chi guarda dall’esterno lo noterà subito.

Come evitare tutto questo?

Con un audit che non si limita al codice.

Con una valutazione strutturata, strategica, metodologica.

Con un framework che guarda l’azienda nel suo insieme, non solo al modello in sé.

Il GamePlan Check Up per startup AI è pensato proprio per questo.

Richiedilo ora se vuoi presentarti agli investitori con lucidità, struttura e zero sorprese.